En Bref

- Un selfie ne contient pas assez d’informations pour une reconstruction 3D fidèle sans hypothèses sur l’arrière du visage et le volume.

- La capture de visage dépend d’un éclairage stable, d’un angle cohérent et d’une optique peu déformante, sinon les proportions dérivent.

- La texture 3D issue d’une photo unique doit être nettoyée, sinon les ombres et reflets deviennent des “taches” imprimées.

- La contrainte technique d’impression 3D impose des épaisseurs minimales, des supports, et un maillage fermé, ce qui oblige souvent à retoucher.

- Un pipeline efficace combine stylisation, modélisation 3D, sculpture numérique, puis validation “imprimable” avant export OBJ/STL.

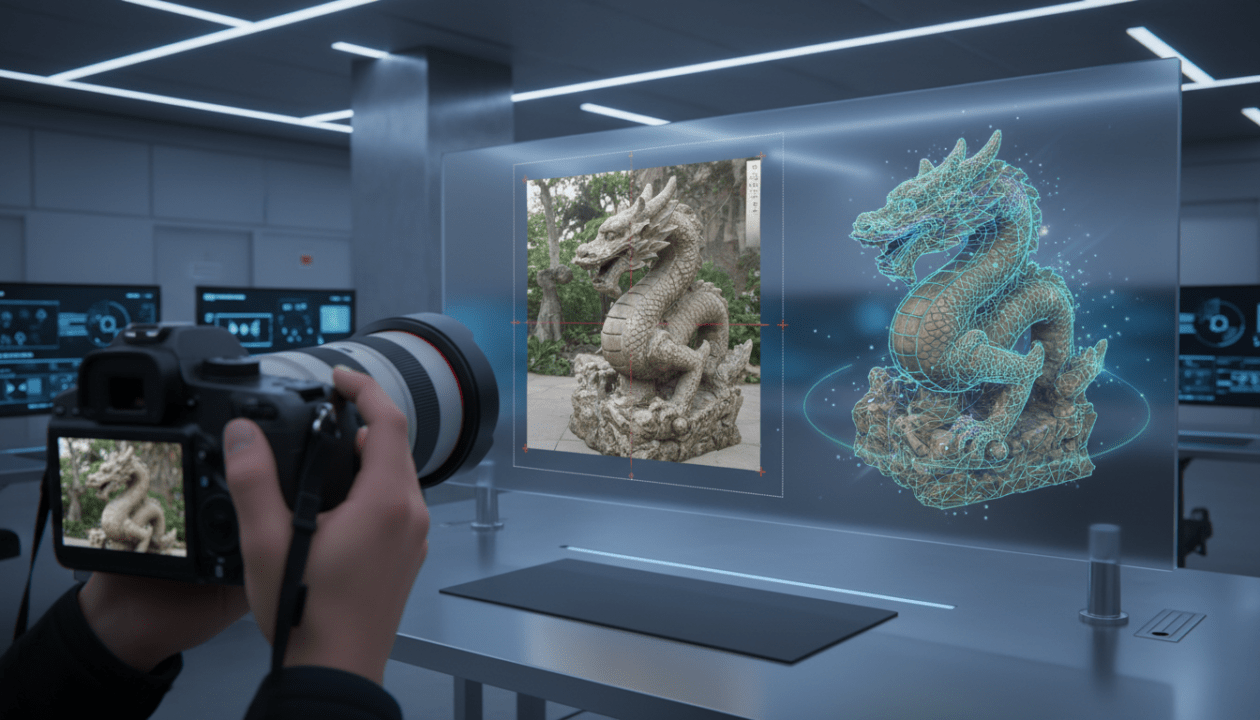

Transformer un selfie en figurine 3D séduit parce que la promesse paraît simple : une photo, puis un objet. Pourtant, dès que l’objectif devient l’impression, la réalité technique se rappelle vite. Une image aplatie ne décrit ni l’épaisseur des paupières, ni la profondeur des joues, ni le volume de l’arrière du crâne. Par conséquent, chaque outil de reconstruction 3D doit deviner, lisser et parfois inventer, ce qui crée des écarts entre ressemblance perçue et ressemblance mesurable. Dans un atelier de création de miniatures, ces écarts deviennent concrets : un nez trop fin casse au décollage des supports, une oreille disparaît après ponçage, ou une expression paraît “figée” parce que les ombres du selfie ont été prises pour de la matière.

À mesure que les générateurs 2025-2026 accélèrent, le goulot d’étranglement se déplace. La génération brute peut être rapide, mais l’obtention d’un modèle imprimable et cohérent exige un enchaînement rigoureux : contrôle de la topologie, correction des proportions, simplification des textures, puis calibration pour l’échelle. Ainsi, les contraintes se jouent autant dans la prise de vue que dans les étapes invisibles, entre modélisation 3D et sculpture numérique. Les lignes qui suivent détaillent ces contraintes, avec des exemples concrets et des méthodes éprouvées pour réduire les mauvaises surprises.

Contraintes de capture de visage à partir d’un selfie : géométrie, optique et éclairage

Une capture de visage à partir d’un selfie commence par un paradoxe. L’image semble riche, pourtant elle manque des informations de profondeur. Ainsi, l’algorithme s’appuie sur des repères faciaux, sur des moyennes statistiques, et sur des indices d’ombre. En conséquence, un selfie “flat” peut donner un visage gonflé, tandis qu’un selfie contrasté peut creuser artificiellement les sillons. Le résultat paraît parfois plausible à l’écran, mais il devient fragile quand la résolution d’impression révèle chaque incohérence.

Le premier facteur est l’optique du téléphone. Les focales courtes déforment, surtout près des bords, donc un bras tendu élargit le nez et recule les oreilles. À l’inverse, une focale plus longue, obtenue en reculant et en zoomant légèrement, respecte mieux les proportions. De plus, l’angle de prise de vue compte : un selfie pris de haut “rapetisse” le menton, alors qu’une caméra en dessous accentue les narines. Pour une figurine, ces écarts se traduisent en volumes faux, donc en retouches longues.

Éclairage et expressions : quand la lumière devient une fausse sculpture numérique

La lumière influe parce que beaucoup de pipelines confondent ombrage et relief. Par exemple, une lampe latérale marque une joue d’une grande zone sombre. Ensuite, la reconstruction 3D interprète ce sombre comme un creux réel. À l’impression, la joue devient “taillée”, donc l’expression change. Pour éviter cela, un éclairage frontal doux, ou une lumière diffuse près d’une fenêtre, réduit les ombres dures. De même, un fond simple aide l’algorithme à isoler les contours, donc les cheveux et épaules s’extraient mieux.

L’expression faciale doit rester stable. Certes, un sourire donne du charme, mais il complique la bouche et les dents. Ainsi, une expression légère, avec les lèvres fermées, permet une géométrie plus robuste. De plus, un regard droit limite les asymétries. Une asymétrie réelle peut être conservée, cependant elle doit être intentionnelle, sinon elle ressemble à un bug. Une règle simple fonctionne souvent : si l’expression dépend d’une ombre, elle se perd en 3D.

Cas pratique : une même personne, deux selfies, deux bustes différents

Dans un cas typique d’atelier, une cliente envoie deux photos. La première est un selfie en intérieur, éclairé par un spot plafond. La seconde est une photo prise par un proche, à distance, en lumière naturelle. Malgré un visage identique, le buste issu du premier cliché sort avec des arcades “cassées” et des joues creusées. En revanche, le second donne des volumes plus doux, donc un meilleur point de départ. Ce contraste illustre une contrainte technique simple : la meilleure prise de vue réduit la quantité de sculpture numérique corrective. La suite logique consiste donc à transformer cette bonne photo en base exploitable pour le modèle complet.

Reconstruction 3D depuis une photo : limites des hypothèses et contrôle de la ressemblance

La reconstruction 3D à partir d’une image unique repose sur des suppositions. Comme l’arrière du crâne n’est pas visible, il est extrapolé. De même, les oreilles peuvent être partiellement masquées, donc elles sont reconstruites “au mieux”. Par conséquent, un modèle peut sembler ressemblant de face, mais devenir étrange en profil. Or une figurine 3D se regarde sous tous les angles, donc le profil compte autant que la face. Voilà pourquoi les workflows sérieux demandent idéalement une vue de face et une vue de profil, même si le point de départ reste un selfie.

Les outils modernes proposent parfois un aperçu 2D stylisé avant la génération 3D. Cette étape n’est pas un gadget. Au contraire, elle sert à stabiliser les contours, à simplifier les détails, et à uniformiser l’éclairage. Ainsi, une image “nettoyée” donne une géométrie plus cohérente. De plus, la stylisation peut masquer des incertitudes, ce qui améliore la perception finale. Pourtant, la stylisation peut aussi dériver, donc la ressemblance doit être contrôlée avec méthode.

Mesurer la ressemblance : repères, proportions et tolérances

Un contrôle efficace compare des repères. La distance inter-pupillaire, la largeur du nez, et la hauteur du front donnent une grille simple. Ensuite, il faut vérifier la silhouette du visage en profil : front, nez, lèvres, menton. Si la ligne “S” du profil devient trop droite, le visage paraît plastique. À l’inverse, si les volumes sont trop accentués, l’impression devient caricaturale. Le bon compromis dépend de l’échelle. À 54 mm, des détails subtils disparaissent, donc il faut parfois exagérer légèrement les reliefs. À 110 mm, la finesse devient visible, donc la précision prime.

Pour garder une approche reproductible, une check-list aide. Elle sert autant au créateur qu’au client, car elle transforme un “ça ne ressemble pas” en corrections actionnables. Par ailleurs, elle évite de corriger au hasard, ce qui fait perdre du temps.

- Front : vérifier le bombé et la transition vers les tempes, surtout si la coiffure cache la zone.

- Nez : contrôler la largeur des ailes, et renforcer l’épaisseur minimale pour l’impression.

- Lèvres : simplifier les plis, car ils deviennent bruit visuel à petite échelle.

- Oreilles : épaissir le bord externe, sinon il casse au nettoyage des supports.

- Menton : ajuster la projection, car un selfie en contre-plongée fausse ce volume.

Exemple de pipeline “photo éditée → 3D → nettoyage”

Un flux de travail courant commence par l’édition de l’image. Ensuite, l’image passe dans un convertisseur “image vers 3D” qui exporte un fichier type GLB. Puis, une étape de retopologie ou de remesh stabilise le maillage. Un nombre de faces modéré, autour de quelques milliers à quelques dizaines de milliers selon l’échelle, facilite la préparation du STL. Enfin, la phase de correction comble les trous, ferme le mesh, et supprime les surfaces internes. Ce pipeline ne garantit pas la perfection, toutefois il réduit les erreurs structurelles. L’étape suivante consiste à traiter la texture 3D, car le réalisme se joue souvent là.

Pour approfondir les bonnes pratiques de conversion photo vers modèle imprimable, une démonstration vidéo aide à visualiser les étapes critiques, notamment la génération puis le remesh.

Texture 3D et matériaux : gérer la couleur d’un selfie sans imprimer des ombres

La texture 3D issue d’un selfie pose une difficulté spécifique. Une photo contient des ombres, des reflets, et une balance des blancs variable. Or, une texture plaquée sur un modèle devient une “peinture” fixe. Ainsi, une ombre sous le nez se transforme en tache permanente, même si la figurine est éclairée différemment. Le problème augmente avec les rendus réalistes, car l’œil humain attend une cohérence entre lumière réelle et shading. Pour une figurine à peindre, cette texture sert surtout de référence. Pour une figurine en couleur, elle doit être corrigée, sinon la peau paraît sale.

La première étape consiste à neutraliser l’éclairage. On peut réduire les contrastes, corriger la teinte, et uniformiser les zones de peau. Ensuite, il faut traiter les zones difficiles : sourcils, barbe, cheveux. Les cheveux en selfie sont souvent “bruités”, donc la texture devient granuleuse. Dans une approche méthodique, mieux vaut simplifier les masses, puis suggérer des mèches par sculpture plutôt que par pixels. Cette logique améliore la lisibilité après impression 3D, surtout en résine.

Projection UV : éviter les coutures visibles

Une texture propre dépend d’UV propres. Or, des générateurs créent parfois des UV automatiques qui coupent le visage sur la joue. Ensuite, une couture traverse la peau, donc même une bonne texture devient visible. Pour limiter cela, des coutures doivent être placées derrière les oreilles, sous la mâchoire, ou dans des zones cachées. De plus, la densité de pixels doit être priorisée sur le visage, car c’est là que la ressemblance se joue. Si la même résolution texture est répartie uniformément, le visage perd des détails, tandis que le torse en reçoit trop.

Un exemple concret : sur une figurine de 110 mm, un fichier texture 2K peut suffire si l’UV est optimisé. En revanche, si l’UV gaspille l’espace, même une texture 4K reste molle. Par conséquent, la qualité perçue ne dépend pas uniquement de la taille du fichier, mais de la répartition. Cela explique pourquoi deux modèles “même résolution” peuvent produire des résultats très différents.

De la texture à la figurine à peindre : quand retirer la couleur améliore le résultat

Dans beaucoup de projets, la figurine est livrée non peinte, prête à recevoir une mise en couleur manuelle. Dans ce cas, la texture sert à guider la sculpture numérique des micro-volumes : plis des paupières, contour des lèvres, volumes des pommettes. Ensuite, la couleur est volontairement écartée à l’export STL. Cette stratégie évite l’écueil des ombres imprimées. De plus, elle donne une surface homogène, ce qui facilite l’apprêt et les glacis. Un bon modèle est donc celui qui reste lisible sans texture. Cette exigence prépare aussi l’étape la plus stricte : la validation imprimable.

Pour visualiser comment les textures et la lumière interagissent sur une tête 3D, une vidéo orientée “texturing/UV” apporte un complément utile avant la phase d’impression.

Impression 3D d’une figurine 3D issue d’un selfie : épaisseurs, supports et échelle

L’impression 3D impose des règles physiques. Un modèle peut être magnifique à l’écran, mais impraticable en résine si certains volumes sont trop fins. Ainsi, des lunettes, des doigts séparés, ou des mèches détachées demandent une épaisseur minimale. Sinon, la pièce casse au retrait des supports, ou se déforme au post-traitement. Cette contrainte technique explique pourquoi la phase “imprimabilité” est une étape distincte, et non une simple exportation.

L’échelle change la stratégie. À 54 mm, une figurine destinée aux wargames doit résister à la manipulation. Donc, les éléments fragiles sont fusionnés, les interstices sont réduits, et les détails sont renforcés. À 110 mm, la pièce devient vitrine, donc les détails peuvent être plus fins, mais les surfaces doivent rester propres. À 200 mm, la masse augmente, donc les risques de déformation et de suction cups en résine montent. Dans ce cas, un évidement et des trous de drainage deviennent nécessaires. Ce sont des choix de fabrication, pas des préférences esthétiques.

Supports et orientation : préserver le visage

Le placement des supports est déterminant, surtout sur un visage. Des supports sur le nez ou la joue laissent des marques, même après ponçage. Par conséquent, une orientation qui place le visage à l’abri réduit la retouche. Souvent, une légère inclinaison vers l’arrière, avec supports sous le menton et derrière la tête, fonctionne bien. Cependant, chaque pose change les zones critiques. Un bras proche du torse crée des poches de résine, donc des défauts. Une cape peut former une grande surface, donc des stries si la résolution de couche est trop élevée.

Des profils d’impression dédiés aident à standardiser le rendu. Par exemple, un profil “buse 0.4” en FDM vise une hauteur de couche autour de 0,12 mm pour conserver des détails acceptables sur de petites pièces. En FDM fin, une buse 0,2 et 0,06 mm de couche améliore les traits, mais augmente le temps et les risques. En résine, la logique change : les couches fines renforcent les détails, toutefois la pièce devient plus sensible à l’orientation et aux supports. Dans tous les cas, le visage doit rester la zone la plus protégée.

Exemple fil conducteur : une commande “mini-moi” pour trois usages

Une commande fictive illustre les compromis. Une personne souhaite un avatar pour jeu de plateau, un cadeau, et une version vitrine. Pour le jeu, la version 54 mm privilégie la solidité, donc les doigts sont rapprochés et les accessoires simplifiés. Pour le cadeau, la version 110 mm conserve plus de détails de cheveux, car la manipulation est rare. Pour la vitrine, une version 200 mm accepte une base plus large et des détails de vêtement plus marqués, mais elle demande évidement et drainage. Ce triptyque montre une règle : la même base de modélisation 3D doit être déclinée selon le contexte d’usage. Une bonne méthode consiste à figer une “source” propre, puis à créer des variantes orientées fabrication.

À ce stade, la réussite dépend aussi du format de fichier et des échanges. Une dernière zone de friction apparaît souvent : exporter correctement, avec textures si besoin, et conserver la compatibilité des logiciels.

Fichiers, formats et retouches : OBJ, textures, et nettoyage avant production

Le passage du modèle à un fichier exploitable semble trivial, pourtant il concentre des erreurs fréquentes. Un export OBJ avec textures garde la couleur, utile pour prévisualiser et pour certaines chaînes de production. En revanche, un STL se concentre sur la géométrie, ce qui est plus direct pour l’impression 3D. Ainsi, le choix dépend du but : imprimer chez soi, envoyer à un service, ou archiver un master. Dans un flux professionnel, conserver les deux est souvent pertinent : OBJ pour la texture 3D, STL pour la fabrication.

Les modèles issus de génération automatique peuvent contenir des défauts : surfaces internes, triangles inversés, auto-intersections, ou zones non-manifold. Ensuite, le slicer interprète mal, donc des trous apparaissent, ou la pièce est creuse par accident. Une procédure de nettoyage limite ces surprises : vérification du maillage, fermeture des volumes, puis uniformisation des normales. De plus, un remesh contrôlé stabilise la densité de triangles, ce qui évite des micro-facettes sur des zones lisses comme le front. La qualité finale se joue ici, car un bon lissage respecte les volumes sans “fondre” les traits.

Compatibilité et chaîne logicielle : éviter les pertes entre outils

Les échanges entre logiciels peuvent casser des matériaux ou des unités. Par conséquent, il faut verrouiller l’échelle. Un modèle de 110 mm exporté en mètres devient gigantesque, donc le slicer applique des supports absurdes. Une méthode fiable consiste à définir une unité de travail, puis à vérifier la hauteur totale en millimètres à chaque étape. Ensuite, l’épaisseur minimale est re-testée après remesh, car certaines opérations réduisent involontairement les bords fins. Cette rigueur évite les retours en arrière.

Pour les services qui proposent une génération rapide, un aperçu 2D puis une génération 3D sur validation peut être une bonne pratique. L’aperçu sert de “contrat visuel”, tandis que la génération 3D finalise le volume. Ensuite, une équipe ou un processus de contrôle peut corriger les défauts courants en 24 heures ouvrées, selon l’organisation. Enfin, l’option de commander une figurine imprimée, en résine haute définition, réduit la charge côté utilisateur. Cependant, même avec un service, un contrôle reste utile, car l’intention artistique varie selon les styles.

Stylisation et univers : gérer les écarts entre “réalisme” et “personnage”

Les bibliothèques de styles, du chevalier au cyberpunk, donnent un cadre. Pourtant, chaque style modifie les proportions : yeux plus grands, mâchoire plus carrée, peau simplifiée. Ainsi, la ressemblance ne doit pas être évaluée comme une photo, mais comme une caricature contrôlée. Un bon indicateur consiste à préserver trois signatures : la ligne du nez, la forme du menton, et l’écart des yeux. Ensuite, le reste peut être stylisé sans perdre l’identité. Cette approche réduit la frustration, car elle fixe un objectif réaliste : une figurine cohérente, pas un clone médical.

Quand ces choix sont posés, la création devient plus fluide. Au lieu de lutter contre le selfie, le processus le transforme en matériau exploitable. La clé reste une discipline de vérification, car une figurine réussie est d’abord un objet manufacturable.

Un seul selfie suffit-il pour une figurine 3D vraiment ressemblante ?

Un seul selfie peut donner une base, cependant la reconstruction 3D doit deviner les volumes cachés, surtout en profil. Pour améliorer la ressemblance, une vue de face plus une vue de profil, avec lumière douce et fond simple, réduisent les approximations et donc les retouches.

Pourquoi le visage paraît parfois “gonflé” ou “creusé” après modélisation 3D ?

Les algorithmes interprètent souvent les ombres du selfie comme du relief. Ainsi, un éclairage dur peut transformer une joue ombrée en creux, tandis qu’une photo plate peut lisser les volumes. Une image mieux éclairée, ou une étape de stylisation/neutralisation, stabilise la géométrie.

Quel format choisir entre OBJ avec textures et STL pour l’impression 3D ?

OBJ avec textures convient si la texture 3D doit être conservée pour prévisualisation ou production couleur. STL est préférable pour une impression 3D classique, car il ne garde que la géométrie. Dans un flux sérieux, conserver OBJ pour l’archive et STL pour la fabrication évite des pertes.

Quels sont les défauts de maillage les plus courants avant l’impression ?

Les problèmes fréquents sont les trous, les surfaces internes, les zones non-manifold et les auto-intersections. Ensuite, le slicer peut générer des parois manquantes ou des volumes incohérents. Un nettoyage puis un remesh contrôlé sécurisent l’imprimabilité.

Comment éviter que les supports abîment le visage en résine ?

L’orientation doit éloigner les points d’attache des zones visibles, notamment le nez, les joues et le front. Une inclinaison modérée, avec supports derrière la tête et sous le menton, limite les marques. Ensuite, des supports plus fins et mieux répartis réduisent le ponçage sur les détails.

Créatrice passionnée de figurines 3D, je mets mon savoir-faire et ma créativité au service de modèles uniques qui prennent vie sous mes doigts. À 27 ans, je combine technique et art pour transformer des idées en objets tangibles.