En Bref

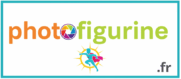

- La photogrammétrie transforme une photo 2D (ou une série d’images) en fichier 3D grâce à la corrélation d’images et à la triangulation.

- La réussite dépend surtout des techniques de capture : recouvrement, lumière diffuse, angles variés et stabilité, plus que du matériel.

- Le cœur du pipeline : points homologues, reconstruction 3D, nuage de points, maillage et textures, puis export vers des formats standards.

- Les rendus servent autant la modélisation 3D de figurines que la topographie et la cartographie, via orthophotos et relevés mesurables.

- Les limites viennent surtout des surfaces brillantes, de l’eau, du verre et des scènes en mouvement, qui perturbent l’alignement.

Transformer une scène réelle en objet numérique manipulable n’a plus rien d’un tour de magie, à condition de comprendre le mécanisme. Une image numérique semble plate, pourtant elle contient des indices de profondeur dès qu’elle est mise en série. En multipliant les points de vue, la photogrammétrie reconstitue des volumes, puis les convertit en données exploitables : nuages de points, maillages texturés, et exports adaptés à la fabrication comme à la mesure. Cette logique explique pourquoi un simple smartphone peut suffire pour capturer une statuette, alors qu’un drone devient préférable pour un talus ou un chantier.

Dans les ateliers de modélisation 3D, la photogrammétrie sert souvent de passerelle. Une sculpture en pâte, un décor miniature, ou une pièce kitbashée gagnent en rapidité de numérisation. Dans les métiers de terrain, la même chaîne soutient le scanning d’une tranchée et la production d’une orthophoto géoréférencée. Les usages diffèrent, mais la règle reste identique : plus la capture est rigoureuse, plus le passage de la photo 2D au fichier 3D devient fiable, mesurable et réutilisable.

Photogrammétrie : comment une photo 2D devient un fichier 3D exploitable

La photogrammétrie repose sur un principe proche de la vision humaine. Deux yeux suffisent pour percevoir le relief, car ils observent la même scène avec un léger décalage. De façon comparable, une série de clichés pris sous des angles différents offre un “décalage” que des algorithmes transforment en profondeur. Ainsi, la reconstruction 3D ne vient pas d’une seule photo 2D, mais d’un ensemble cohérent d’images avec recouvrement.

Le pipeline commence par la détection automatique de détails répétables. Le logiciel repère des textures, des coins, des micro-contrastes, puis associe ces signatures entre plusieurs vues. Ces correspondances s’appellent souvent points homologues. Ensuite, la triangulation calcule la position 3D de ces points, car l’écart entre les observations encode la distance. Plus les angles sont variés, plus le calcul se stabilise, car l’erreur se répartit au lieu de s’accumuler.

Points homologues, corrélation d’images et triangulation : le cœur du calcul

La corrélation d’images remplace un travail humain impraticable à grande échelle. Un opérateur pourrait identifier quelques repères, pourtant une scène utile en contient des milliers, parfois des millions. L’ordinateur, lui, parcourt les pixels et compare des motifs sur plusieurs prises. Ensuite, il estime la position des caméras, puis il reconstruit l’espace à partir des écarts observés. Cette étape donne un premier nuage de points dit “clairsemé”, suffisant pour comprendre la géométrie globale.

Une seconde phase densifie les données. Les algorithmes ajoutent des points dans les zones texturées, ce qui donne un nuage de points dense. À partir de là, un maillage (mesh) peut être généré, puis une texture est projetée. Le résultat final devient un fichier 3D que les logiciels de sculpture numérique, de DAO ou de rendu temps réel peuvent ouvrir. La cohérence dépend alors de la capture : si des zones manquent de recouvrement, le modèle présentera des trous ou des déformations.

Du nuage de points à l’orthophoto : quand la 3D sert aussi la mesure

La photogrammétrie ne produit pas uniquement des meshes. Elle peut aussi générer une orthophoto, c’est-à-dire une image “redressée” sans distorsion de perspective. Cette sortie devient un fond de plan fiable pour tracer des réseaux, vérifier des implantations, ou préparer un récolement. Dans ce cas, l’image numérique n’est plus une photo classique, car son échelle est contrôlée et sa géométrie est corrigée.

Dans les métiers de topographie et de cartographie, cette capacité change la façon de documenter le terrain. Une tranchée filmée proprement peut être convertie en orthophoto géoréférencée, puis vectorisée. De même, un talus photographié par drone peut fournir des profils et des volumes. Cette logique explique la place croissante de la photogrammétrie dans les chantiers récents, car elle relie la preuve visuelle et la mesure. Le point décisif reste simple : sans recouvrement et sans stabilité, aucune précision durable ne peut émerger.

Une fois le principe acquis, la question suivante devient pratique : comment capturer une série d’images qui “tient” réellement, que l’objet soit une figurine ou un chantier. La méthode d’acquisition fait souvent la différence entre un modèle agréable et un modèle mesurable.

Techniques de capture en photogrammétrie : angles, recouvrement, lumière et stabilité

Les techniques de capture déterminent la qualité finale bien plus que la marque de l’appareil. Un smartphone moderne suffit souvent, car il produit des images nettes et riches. Toutefois, une bonne capture suit des règles strictes : angles variés, recouvrement régulier, exposition stable, et absence de flou. Sans cela, le logiciel “comprend” mal la scène, car il ne retrouve pas les mêmes détails d’une image à l’autre.

Une règle opérationnelle consiste à imaginer une bulle autour de l’objet. Les positions de prise de vue doivent envelopper la scène, au lieu de rester sur un seul arc. Sinon, les zones cachées, comme le dessous d’un balcon ou l’arrière d’une figurine, deviennent des “occlusions”. De façon concrète, il faut tourner autour, puis incliner l’appareil pour couvrir le dessus et les angles difficiles. Cette logique rappelle une inspection visuelle : sans changer de hauteur, certaines formes restent invisibles.

Procédure de prise de vues : le “dôme” de photos qui évite les trous

Pour une petite pièce, un plateau tournant aide, car il stabilise la distance. Cependant, il faut éviter un fond uniforme sans texture, car il prive le logiciel de repères. À l’inverse, un fond texturé, non brillant, améliore l’alignement. Pour un sujet plus grand, la marche autour du volume doit rester régulière, car des sauts d’angle trop brusques compliquent l’estimation des caméras. Enfin, un recouvrement élevé entre images maintient des correspondances fiables.

Voici une liste de contrôle simple, utile avant tout lancement de calcul :

- Recouvrement constant : chaque photo doit partager une grande partie de la scène avec la précédente.

- Angles multiples : varier hauteur et inclinaison, surtout pour les zones sous-coupes.

- Neteté : éviter le flou de bougé, donc privilégier une vitesse suffisante.

- Exposition stable : limiter les variations de luminosité entre clichés.

- Distance maîtrisée : garder une échelle cohérente, afin d’éviter des ruptures de résolution.

Cette discipline paraît stricte, pourtant elle économise des heures de nettoyage. Un modèle bien capturé sort souvent avec moins de “bouillie” sur les arêtes et moins de trous, ce qui accélère la suite en sculpture ou en retopologie.

Capteur, résolution et lumière : pourquoi les “jours blancs” aident

La résolution influe sur la précision locale. Plus les détails sont fins, plus les points homologues se stabilisent, et plus le nuage dense devient riche. Néanmoins, une haute résolution ne compense pas un manque d’angles. Il existe donc un équilibre : couverture complète et pixels exploitables. Dans un atelier, cela se traduit par une distance raisonnable et une série plus longue, plutôt qu’un seul cliché ultra-détaillé.

La lumière, quant à elle, agit comme un piège discret. Une scène très contrastée crée des zones “brûlées” et des zones “bouchées”, donc des zones sans détails. Or, sans détails, pas de corrélation fiable. Une lumière diffuse, comme par temps couvert, produit des ombres douces et un contraste plus homogène. En studio, des softboxes jouent le même rôle. Le RAW peut aussi aider, car il conserve davantage d’informations qu’un JPEG compressé. Au final, une capture réussie n’est pas spectaculaire, elle est constante, et c’est précisément ce qui rend la géométrie robuste.

Après l’acquisition, le traitement transforme les images en géométrie, puis en livrables concrets. À ce stade, comprendre les formats et les sorties permet d’éviter un fichier 3D beau mais inutilisable dans le workflow suivant.

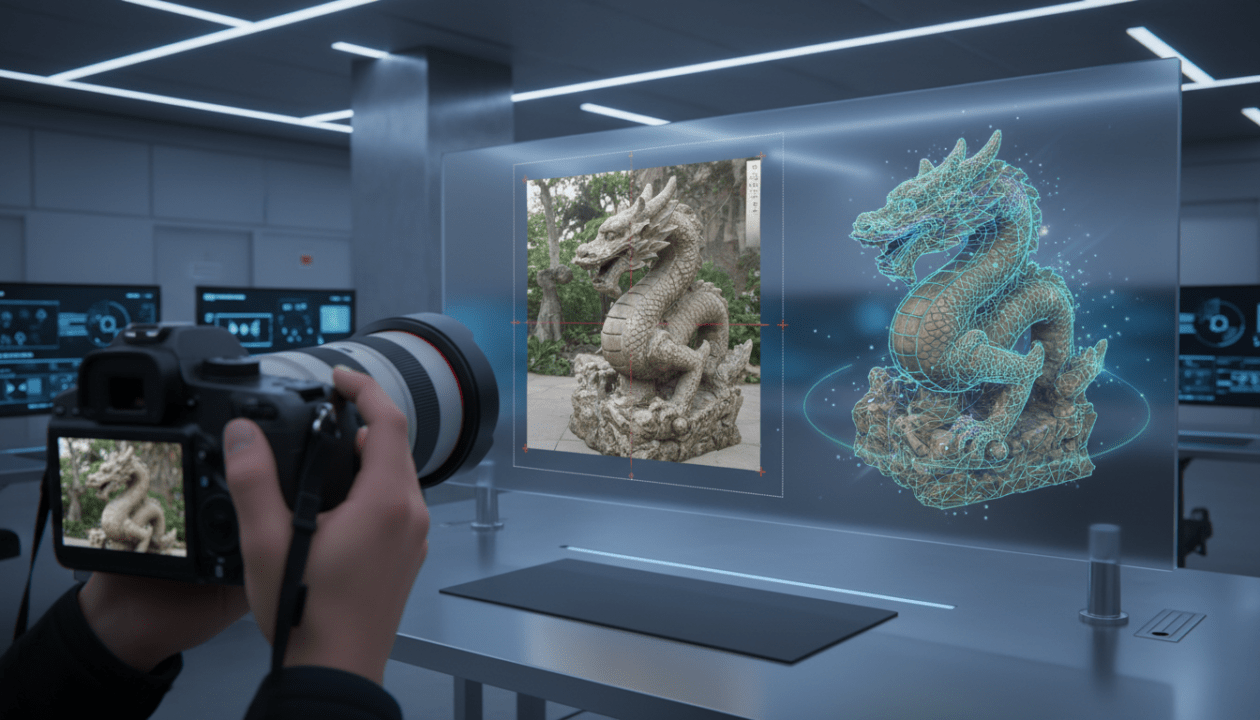

Chaîne de traitement photogrammétrique : nuage de points, maillage, textures et exports

Une chaîne de traitement bien organisée évite les surprises en bout de course. D’abord, les images sont alignées, et les positions de caméra sont estimées. Ensuite, un nuage clairsemé valide la cohérence globale. Puis, le logiciel calcule un nuage dense, plus lourd, mais plus précis. Enfin, il génère un maillage et projette des textures, ce qui donne un rendu photoréaliste utile pour le visuel comme pour la référence matière.

Dans un contexte de figurines, le maillage brut sert rarement tel quel. Il est souvent trop dense, avec des triangles irréguliers. Cependant, il donne une base fidèle pour reconstruire proprement. Une pratique courante consiste à retopologiser, puis à reprojeter les détails en normal map ou displacement. Ainsi, le modèle devient compatible avec l’animation, le rendu, ou l’impression. La photogrammétrie joue alors un rôle de “capture”, tandis que la modélisation 3D finalise le produit.

Orthophotos géoréférencées et livrables terrain : de la preuve visuelle à la DAO

Sur chantier, la photogrammétrie s’adosse souvent au géoréférencement. Une orthophoto redressée, associée à des points GNSS, devient une base fiable pour vectoriser. Certaines solutions récentes simplifient ce flux : une tranchée est filmée au smartphone, puis la vidéo est transformée en orthophotos et modèles 3D. Ensuite, ces données sont intégrées à un portail de suivi pour tracer les réseaux et archiver le récolement. Avec un récepteur GNSS centimétrique, la cohérence spatiale s’améliore, ce qui évite des reprises coûteuses.

Les exports couvrent des usages variés. Une orthophoto peut sortir en .tif, tandis qu’un nuage de points peut être livré en .las. Pour la DAO, un export .dxf reste courant, et pour le SIG, des formats comme .shp ou .gml facilitent l’intégration. Le point important est d’anticiper le destinataire : un artiste 3D attend un mesh et des textures, alors qu’un géomaticien attend des coordonnées et une projection claire. Une chaîne efficace commence donc par une question simple : “à quoi servira ce modèle ?”.

Photogrammétrie vs scanning LiDAR : choix pragmatique selon la scène

La photogrammétrie et le scanning LiDAR produisent tous deux des nuages de points, pourtant ils réagissent différemment. La photogrammétrie dépend de l’apparence visuelle, donc elle excelle sur les surfaces texturées et mates. En revanche, un scanner LiDAR mesure des distances par retour de signal, ce qui le rend plus stable sur certaines géométries. Toutefois, il n’est pas immunisé contre les reflets, et il demande souvent un matériel plus coûteux.

Le cas des objets en mouvement illustre bien la différence. Une rue animée pose problème à la photogrammétrie, car les voitures changent de place entre les clichés. À l’inverse, le LiDAR capture des positions instantanées, même si le nuage se retrouve “pollué” et doit être nettoyé. En production, le bon choix dépend donc du contexte : photogrammétrie pour le réalisme et la texture, LiDAR pour la robustesse métrique et la scène dynamique, ou encore une combinaison des deux. Un workflow mature sait mixer les outils au lieu de chercher une solution unique.

Quand le pipeline est compris, les limites deviennent plus faciles à diagnostiquer. Certaines erreurs ne viennent pas du logiciel, mais de la physique des matériaux et des conditions de prise de vue.

Limites et pièges de la photogrammétrie : reflets, verre, eau, mouvements et solutions

La photogrammétrie dépend des détails visibles et stables. Or certaines surfaces trahissent cette condition. Une surface brillante reflète son environnement, donc son apparence change selon l’angle. Le logiciel interprète alors des reflets comme de vrais motifs, ce qui crée des déformations. Une table blanche mate se capture facilement, tandis qu’une table laquée conduit souvent à des “bosses” incohérentes.

Deux notions aident à comprendre : la réflectance, soit la part de lumière renvoyée, et la réflexion, soit la manière dont la lumière repart. Une réflexion spéculaire, comme un miroir, renvoie un faisceau dans une direction privilégiée. À l’inverse, une réflexion diffuse, typique d’une surface rugueuse, renvoie la lumière dans plusieurs directions. La photogrammétrie préfère donc les surfaces mates et texturées, car elles restent visuellement cohérentes d’une vue à l’autre.

Surfaces difficiles : comment “matifier” sans abîmer, et quand renoncer

Pour contourner les reflets, une technique consiste à matifier la surface. Des sprays temporaires existent, souvent utilisés en métrologie. Ils créent une micro-couche poudreuse qui casse la brillance. Cependant, cette méthode reste invasive, donc elle ne convient pas toujours, par exemple sur du patrimoine ou sur des objets sensibles. Dans un atelier de figurines, elle peut être acceptable sur une pièce de test, mais elle demande une vérification matière avant usage.

Le verre et l’eau posent une autre difficulté. Voir à travers une vitre revient à ne pas “voir” la surface elle-même. Le logiciel corrèle alors l’arrière-plan, pas le vitrage. Là encore, l’opacification peut aider, mais elle n’est pas toujours possible. Dans ces cas, il vaut mieux modéliser manuellement ces éléments, ou passer par une technique alternative, selon le niveau d’exigence du projet. L’idée clé reste pragmatique : si l’apparence varie, la géométrie dérive.

Mouvements dans la scène : pourquoi le temps devient un paramètre

Une scène vivante, avec des personnes, des feuilles agitées, ou des véhicules, casse l’hypothèse de stabilité. La photogrammétrie assemble des instants différents comme s’ils représentaient un même moment. Résultat : des “fantômes”, des surfaces déchirées, ou des éléments flottants. Un tournage rapide réduit parfois le problème, car l’intervalle entre vues se resserre, donc la scène change moins. Toutefois, cela ne suffit pas sur une rue très passante.

Dans ces conditions, plusieurs stratégies existent. D’abord, choisir un créneau calme, car le terrain se capture mieux à l’aube ou hors flux. Ensuite, masquer ou supprimer les images problématiques, car un petit nettoyage en amont peut stabiliser l’alignement. Enfin, passer au LiDAR ou à une capture hybride peut sauver un projet exigeant. Une bonne pratique consiste à penser “scène” avant de penser “outil”, car la qualité se décide souvent avant même le premier clic.

Après les limites, les usages montrent la portée réelle de la méthode. Entre loisirs, cinéma, jeux vidéo et génie civil, la même base mathématique sert des objectifs très différents, ce qui rend la photogrammétrie particulièrement transversale.

Applications 2026 : figurines, jeux vidéo, cinéma, topographie et cartographie en photogrammétrie

La photogrammétrie s’est installée dans le quotidien sans toujours être identifiée. Les modèles urbains en 3D, visibles dans des services de cartographie en ligne, proviennent souvent de campagnes aériennes. Des prises angulaires réalisées depuis avion, puis assemblées, produisent des meshes “tuilés” et streamés. Cette approche a remplacé, au fil des années, une modélisation manuelle trop lente, car elle automatise une grande part du travail tout en améliorant le réalisme.

Au cinéma, la numérisation d’acteurs, de costumes et d’accessoires s’appuie aussi sur des séries de photos. L’objectif n’est pas seulement de reproduire une forme, mais de capturer une présence visuelle. Dans certains cas célèbres, des techniques proches ont permis de prolonger une performance à l’écran via un double numérique. Le point important est la continuité : un modèle photogrammétrique crédible sert de base, puis il est retouché pour répondre aux contraintes de narration, d’éclairage et d’animation.

De la sculpture réelle à la figurine imprimée : un cas d’usage atelier

Dans la création de figurines, la photogrammétrie sert souvent à préserver une version physique. Une sculpture traditionnelle, réalisée en argile ou en pâte, peut être capturée, puis nettoyée. Ensuite, les défauts sont corrigés, les lignes sont accentuées, et la pièce est découpée pour l’impression. Ce flux accélère la numérisation de formes organiques, car la main produit des volumes naturels, tandis que le numérique affine et industrialise.

Un exemple fréquent concerne les textures de surface. Une peau, un tissu ou une pierre bénéficient d’une capture riche, car les micro-reliefs se lisent bien en photo. En revanche, les zones lisses demandent souvent une reprise, car elles manquent de points distinctifs. Une méthode efficace consiste à capturer pour obtenir la base, puis à sculpter numériquement pour renforcer les zones “faibles”. Le résultat final reste contrôlé, et le fichier 3D devient plus propre pour le slicing, la résine et l’assemblage.

Topographie et cartographie : orthophotos, volumes et documentation de chantier

Sur le terrain, la photogrammétrie produit des livrables qui parlent aux équipes : orthophotos, profils, calculs de cubatures, et modèles 3D consultables. Un tas de gravats, photographié par drone selon un plan de vol, se transforme en volume mesurable. De même, un terrassement peut être archivé en version numérique, ce qui permet de revenir en arrière en cas de litige ou de contrôle. La force de la méthode vient alors de la traçabilité : l’image sert de preuve, et la géométrie sert de mesure.

Les solutions qui combinent smartphone, traitement automatisé et GNSS centimétrique se multiplient, car elles réduisent la barrière d’entrée. La promesse est simple : filmer, traiter, puis vectoriser dans un environnement partagé. Dans ce cadre, la photogrammétrie devient une brique de productivité, pas un gadget. L’insight final est clair : quand la capture est standardisée, la 3D devient un langage commun entre terrain et bureau.

Combien de photos faut-il pour passer d’une photo 2D à un fichier 3D ?

Un seul cliché ne suffit presque jamais. En pratique, la photogrammétrie exige une série d’images avec recouvrement important, prises tout autour du sujet. Pour une petite figurine, quelques dizaines peuvent suffire si la texture est riche. Pour un bâtiment ou un terrain, plusieurs centaines sont courantes, surtout si l’objectif vise une reconstruction 3D complète sans zones manquantes.

Pourquoi un modèle photogrammétrique a parfois des trous ou des surfaces “fondues” ?

Le plus souvent, la cause vient d’un manque d’angles, donc d’occlusions, ou d’un recouvrement trop faible. Une autre cause fréquente concerne la lumière : zones brûlées ou bouchées, donc sans détails corrélables. Enfin, les surfaces brillantes et le verre créent des motifs instables, ce qui entraîne des erreurs de géométrie lors de l’alignement et de la densification.

Photogrammétrie ou scanning LiDAR : quel choix pour la topographie et la cartographie ?

Pour la topographie et la cartographie, la photogrammétrie brille lorsqu’une orthophoto et une texture réaliste sont recherchées, notamment avec drone. Le LiDAR reste très pertinent quand la scène bouge, quand la végétation complique la lecture, ou quand la robustesse métrique prime. Dans de nombreux projets, une approche hybride combine le meilleur des deux : texture photogrammétrique et géométrie LiDAR.

Quels formats d’export sont les plus utiles après reconstruction 3D ?

Cela dépend du destinataire. Une orthophoto sort souvent en .tif. Un nuage de points est fréquemment livré en .las. Pour la DAO, .dxf est courant, tandis que le SIG exploite souvent .shp ou .gml. Pour la modélisation 3D et l’impression, un mesh (souvent en .obj ou .fbx selon les outils) accompagné de textures reste la base, puis une retopologie améliore la production.

Créatrice passionnée de figurines 3D, je mets mon savoir-faire et ma créativité au service de modèles uniques qui prennent vie sous mes doigts. À 27 ans, je combine technique et art pour transformer des idées en objets tangibles.